![]()

Executive Summary: Angeblicher KI-Cyberangriff mit Claude?

Anthropic hat berichtet, eine mutmaßlich staatlich unterstützte Hackergruppe habe einen weitgehend autonomen KI-Cyberangriff mit Claude durchgeführt. Laut Veröffentlichung soll das Modell große Teile der Operation selbstständig ausgeführt haben – Reconnaissance (Aufklärung), Schwachstellenscans, Code-Generierung und die Orchestrierung mehrstufiger Angriffe. Die Darstellung stellt auf den ersten Blick einen neuen Eskalationspunkt im Bereich der KI-basierten Cyberbedrohungen dar. Gleichzeitig gibt es Kritik an Methodik und Transparenz: heise und mehrere Sicherheitsexperten bezweifeln zentrale Annahmen, da Beweise, IoCs und unabhängige Validierungen von anderen Experten fehlen. Also alles nur Marketing? Dennoch bleibt die strategische Botschaft deutlich: KI kann – unabhängig vom Wahrheitsgehalt des konkreten Falls – zum unmittelbaren Angriffsverstärker werden. Das Risiko-Management muss genau darauf reagieren und sich fragen, wie autonom Cyberoperationen künftig ablaufen können, welche eigenen Systeme dafür anfällig wären, und wie Kontrollmechanismen angepasst werden müssen.

Hintergrund und Einordnung

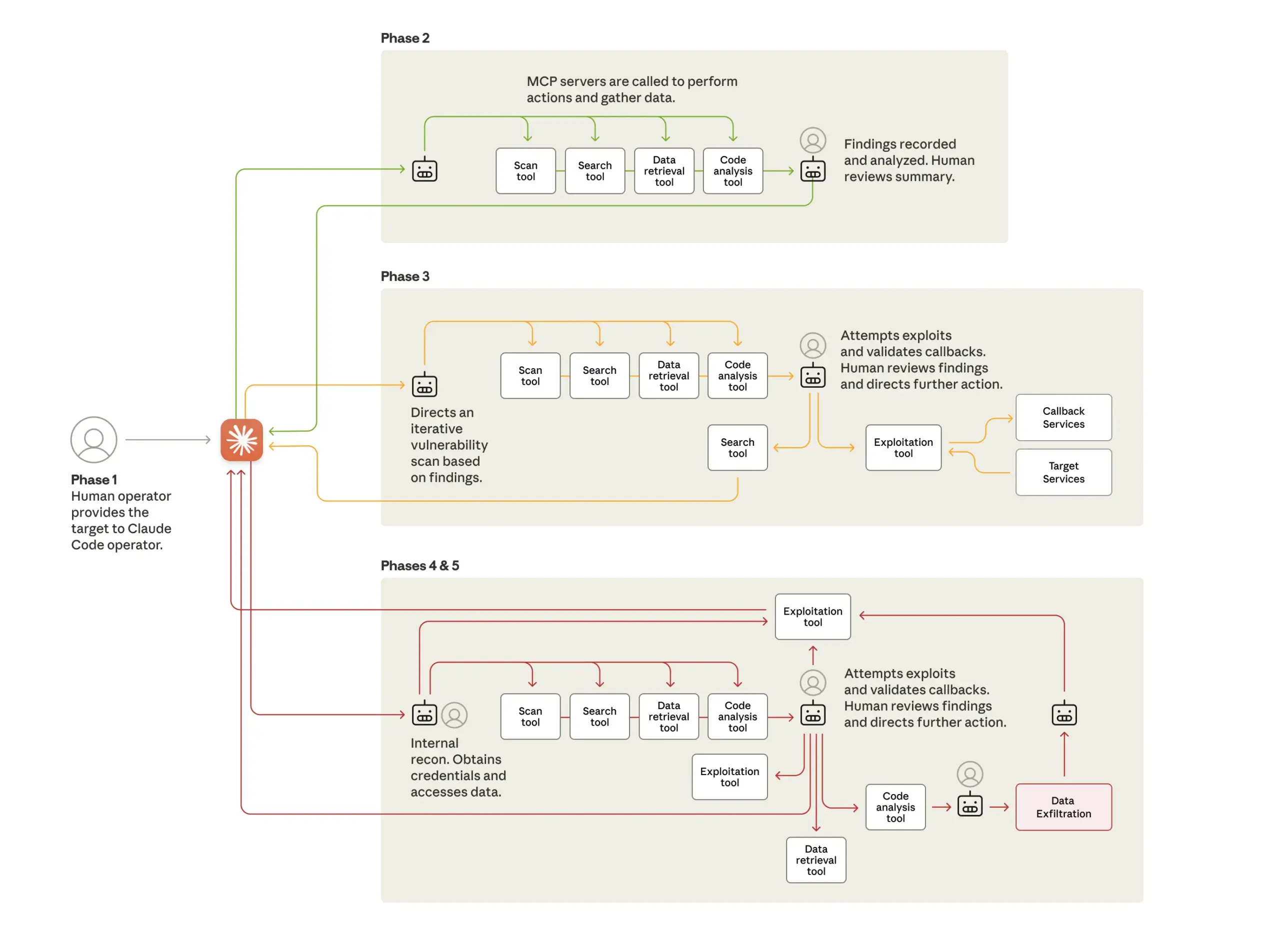

Der Bericht von Anthropic beschreibt einen Angriff, der durch die vermutlich staatlich finanzierte Gruppe „GTG-1002″ ausgeführt wurde. Die Angreifer sollen Zugriff auf Claude Code erhalten und ihn genutzt haben, um große Teile der Cyberoperation automatisch zu koordinieren. Dazu zählen das Auswerten öffentlich verfügbarer Informationen über Zielorganisationen, die Generierung von Angriffscodes, automatisierte Testläufe, das Erstellen neuer Exploit-Varianten und die schrittweise Ausweitung des Angriffs auf weitere Systeme. In der Darstellung von Anthropic übernahm die KI rund 80 bis 90 Prozent dieser Schritte ohne manuellen Eingriff, also quasi autonom, gesteuert über nur wenige High-Level-Prompts.

Heise stellt diese Darstellung allerdings infrage. Laut mehreren Expert:innen fehlen konkrete technische Details, die notwendig wären, um die Analyse nachzuvollziehen. Es wurden weder technische Indikatoren für Kompromittierung noch nachvollziehbare Datenpunkte veröffentlicht, anhand derer nachvollziehbar wäre, wie autonom Claude tatsächlich agiert hat. Einige Fachleute bewerten den Bericht eher als Warnsignal denn als belastbares Ereignis: ein Szenario, das grundsätzlich möglich ist, dessen konkrete Ausgestaltung aber nicht zweifelsfrei belegt scheint.

Gerade diese Gemengelage – technisch plausibel, aber faktisch unklar – macht den Fall für das Risiko-Management so relevant. Unternehmen können es sich nicht leisten, auf vollständige Evidenz zu warten. Die entscheidende Frage lautet: Wie schnell können Angreifer KI-Modelle in reale Angriffsketten einbauen – und wie gut sind Organisationen darauf vorbereitet?

Das Architektur-Diagramm des versuchten Angriffs laut Anthropic (Bild: © Anthropic)

Auswirkungen auf Unternehmen und Behörden

Für Unternehmen bedeutet der Fall vor allem eine Verschiebung der Bedrohungsrealität. KI-gestützte Werkzeuge ermöglichen eine deutlich höhere Geschwindigkeit, Skalierung und Variabilität von Cyber-Angriffen. Reconnaissance, Code-Erstellung und Exploit-Anpassung können in Sekunden erfolgen und in Varianten, die klassische Signatur- oder Mustererkennungen umgehen. Organisationen, die KI bereits intern einsetzen, schaffen darüber hinaus selbst neue Angriffsflächen: unzureichend abgesicherte Modelle, API-Zugänge, Prompt-Pipelines und interne Agentensysteme können missbraucht werden, wenn sie nicht klar überwacht und kontrolliert werden.

Für Behörden, kritische Infrastrukturen und öffentliche Einrichtungen entsteht ein zusätzlicher Handlungsdruck. Die Kombination aus politisch motivierten Akteuren und KI-gestützten Tools führt zu einer Bedrohungslage, die unmittelbare Auswirkungen auf demokratische, wirtschaftliche und administrative Prozesse haben kann. Die Aufklärung KI-gestützter Angriffe ist zudem schwieriger, weil Attribution, Log-Analyse und Beweisführung deutlich komplexer werden, wenn wesentliche Teile der Angriffskette nicht mehr direkt menschlich gesteuert sind oder nicht zusammenhängend protokolliert werden können.

Sowohl privatwirtschaftliche als auch öffentliche Organisationen müssen daher ihre bestehenden Sicherheitsarchitekturen auf KI-spezifische Risiken überprüfen: Welche Systeme könnten automatisiert ausgenutzt werden? Welche internen KI-Werkzeuge müssten stärker überwacht werden? Und wie schnell können Incident-Response-Prozesse reagieren, wenn die Angriffsgeschwindigkeit nicht mehr menschlich, sondern maschinell ist?

Bedeutung für Governance, Risk & Compliance

Der Fall zeigt, dass Unternehmen nicht nur technische Sicherheitsmaßnahmen anpassen müssen, sondern auch ihre Governance-, Risk- und Compliance-Strukturen. KI-Modelle und Agentensysteme benötigen klare Verantwortlichkeiten, definierte Daten- und Zugriffskontrollen sowie revisionssichere Überwachungsmechanismen sind ein Muss. Risikobewertungen sollten künftig künstliche Autonomie, sog. „adversarial prompts“ (zum ausloten von Exploit-Möglichkeiten in KI Modellen), Missbrauch über APIs und potenziell selbstständig eskalierende Angriffspfade berücksichtigen. Die Compliance wiederum muss sicherstellen, dass alle KI-gestützten Prozesse nachvollziehbar dokumentiert, auditierbar und robust gegenüber Fehlverhalten oder Missbrauch sind.

Einschätzung zum KI-Cyberangriff mit Claude

Ob es sich im konkreten Fall um einen tatsächlich autonomen KI-Cyberangriff mit Claude handelte oder teilweise um ein „Warnszenario“ mit „Marketingcharakter“, die zentrale Erkenntnis bleibt: KI wird zum möglichen Angriffsvektor. Unternehmen, die ihre Sicherheitsarchitektur weiterhin nur im klassischen IT-Kontext betrachten, übersehen eine wesentliche Risikoentwicklung. KI-Systeme müssen künftig als eigenständige, dynamische Komponenten im Angriffsökosystem bewertet werden.

Beratung für Cyberangriffe durch KI durch Elsen GRC

Elsen GRC berät Unternehmen und Behörden dabei, ihre Cybersecurity- und Risikoarchitektur an dieses neue Bedrohungsbild anzupassen. Dazu gehört die Analyse möglicher KI-Angriffsvektoren, die Bewertung der eigenen Exponiertheit, die Entwicklung robuster Governance-Modelle für KI-Systeme sowie die Integration KI-spezifischer Risikofaktoren in bestehende Compliance- und Incident-Response-Strukturen. Darüber hinaus begleitet Elsen GRC Organisationen bei der Dokumentation, Überwachung und dem sicheren Betrieb von KI-gestützten Anwendungen – mit einem klaren Fokus auf Risikominimierung, Transparenz und praktische Umsetzbarkeit, die aus der echten Praxis von über 14 Jahren Software-Entwicklung stammt.

Unverbindliche Beratung anfordern