Der EU AI Act ist die erste umfassende europäische Verordnung zur Regulierung von Künstlicher Intelligenz. Ziel ist es, den sicheren, transparenten und vertrauenswürdigen Einsatz von KI-Systemen in Europa zu gewährleisten, ohne Innovation zu behindern. Die Verordnung trat am 01. August 2024 in Kraft und kommt mit unterschiedlichen Übergangsfristen, mehr dazu in der rechtlichen Einordnung.

Was der EU AI Act regelt

Der AI Act definiert, was als KI-System gilt, und ordnet diese nach ihrem spezifischen Anwendungs-Risiko ein. Je höher das Risiko für Grundrechte, Sicherheit oder Datenschutz, desto strenger die Anforderungen. Die Verordnung gilt für alle Anbieter, Importeure, Händler und Nutzer von KI-Systemen innerhalb der EU – unabhängig davon, ob die Systeme in der EU entwickelt wurden oder nicht. Das beutetet, auch Unternehmen, die KI (z.B. die API von Open AI, also ChatGPT) in Ihre Anwendungen, Websites oder Produkte integrieren, müssen die Verordnung berücksichtigen.

Risikokategorien des EU AI Act

- Unzulässige KI-Systeme – etwa Social-Scoring oder manipulative Systeme, die verboten werden (auch z.B. Emotionserkennung am Arbeitsplatz)

- Hochrisiko-KI-Systeme – z. B. Anwendungen in kritischen Infrastrukturen, Beschäftigung, Bildung, Justiz oder biometrischer Identifizierung.

- Begrenztes Risiko – Systeme, die Transparenzpflichten erfüllen müssen (z. B. Chatbots, die offengelegt werden müssen).

- Minimales Risiko – Anwendungen, die keine besonderen Pflichten haben.

Anforderungen für Hochrisiko-Systeme

Anbieter solcher Systeme müssen ein umfassendes Risikomanagement-System, Daten- und Qualitätsmanagement, technische Dokumentation sowie Konformitätsbewertung nachweisen. Sie sind verpflichtet, menschliche Aufsicht sicherzustellen und Transparenz gegenüber Nutzern zu gewährleisten.

Praxisrelevanz für Unternehmen

Für Unternehmen bedeutet der AI Act, dass jede KI-Anwendung künftig hinsichtlich ihrer Risikoklasse geprüft und dokumentiert werden muss. Insbesondere SaaS- und Cloud-Anbieter, die KI-Funktionen integrieren, müssen Compliance-Prozesse etablieren, um die Anforderungen frühzeitig zu erfüllen.

Rechtliche Einordnung

Die Verordnung über Künstliche Intelligenz (AI Act) ist Teil der Digitalstrategie der EU und ergänzt bestehende Regelwerke wie die DSGVO und den Data Act. Nach der finalen Zustimmung des Europäischen Parlaments im Jahr 2024 tritt sie voraussichtlich 2025 mit Übergangsfristen von bis zu zwei Jahren in Kraft.

Beispielhafte Artikelverweise:

- Artikel 5 ff. – Verbotene KI-Praktiken

- Artikel -.7 – Hochrisiko-Systeme

- Artikel 8-15 – Pflichten der Anbieter

- Artikel 69 – Sanktionen bei Verstößen

Beratung im Rahmen des EU AI Act durch Elsen GRC

Elsen GRC unterstützt Unternehmen dabei, ihre KI-Systeme frühzeitig auf AI-Act-Konformität zu prüfen und erforderliche Governance-Strukturen aufzubauen. Dazu gehören Risikoanalysen, die Zuordnung zu Risikoklassen, der Aufbau von Nachweis- und Dokumentationspflichten sowie die Integration des Themas KI-Compliance in bestehende Datenschutz- und ISMS-Strukturen. Ziel ist es, regulatorische Sicherheit zu schaffen, ohne Innovation zu bremsen.

Unverbindliche Beratung zum EU AI Act anfordernNews zum EU AI Act

Quellen:

- EUR-Lex: Regulation (EU) 2024/1689 of the European Parliament and of the Council of 13 June 2024 laying down harmonised rules on artificial intelligence (LINK)

- EU Commission News: “AI Act enters into force” – 1. August 2024 (LINK)

- “The Act Texts | EU Artificial Intelligence Act” – artificialintelligenceact.eu (12 Juli 2024), (LINK)

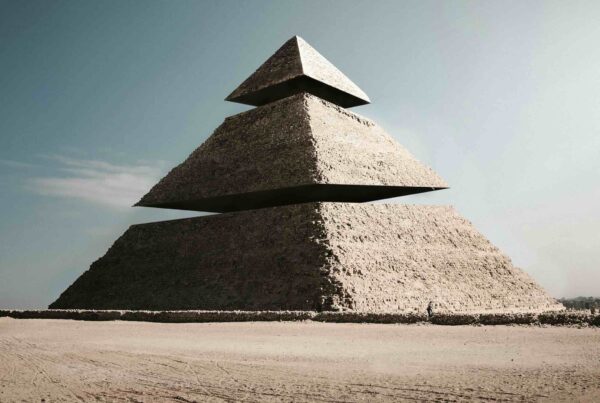

Bild von ALEXANDRE LALLEMAND – Unsplash.com

7 Comments