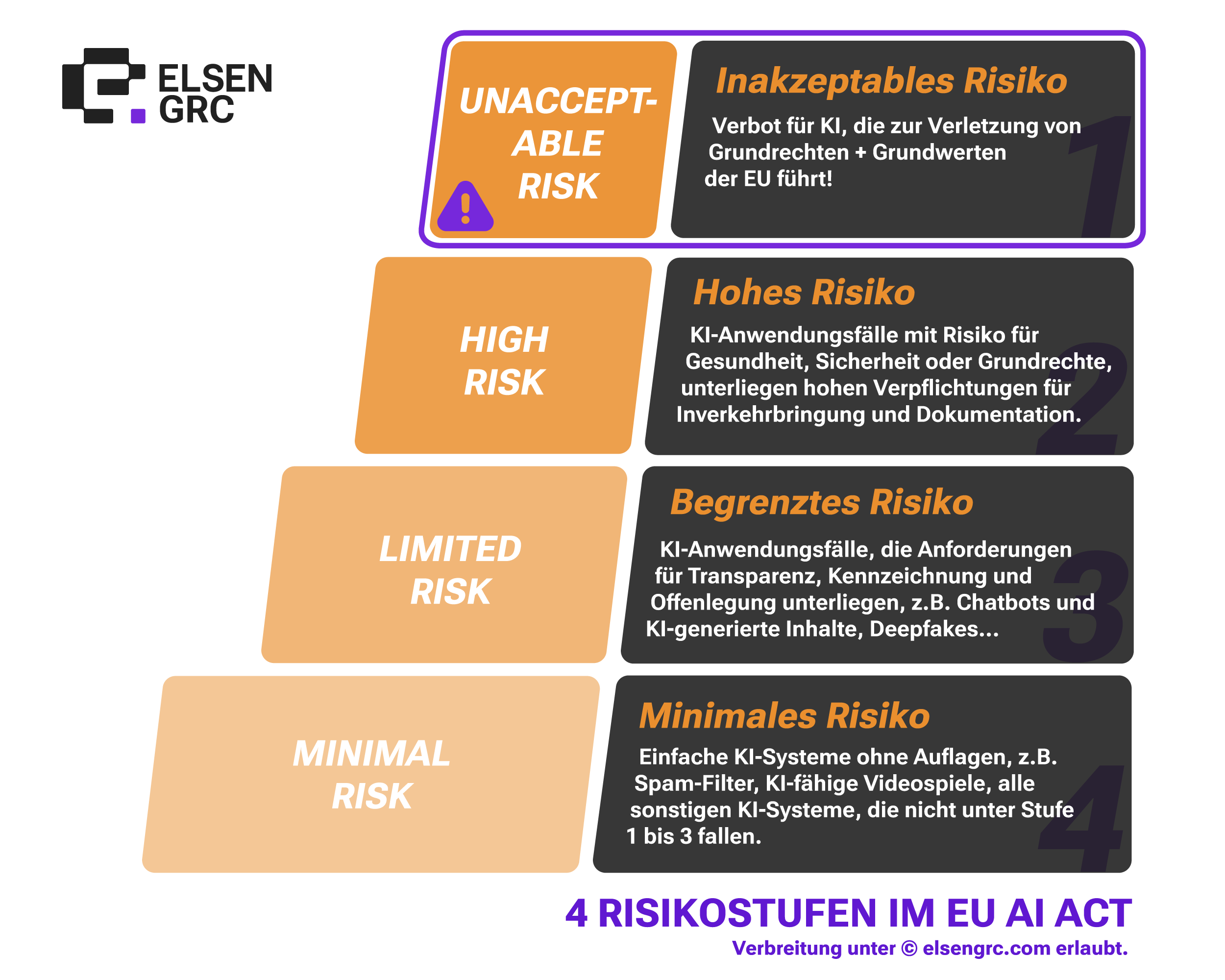

Der EU AI Act verfolgt einen klaren, risikobasierten Ansatz: KI-Systeme werden je nach Gefährdungspotenzial in vier Risikostufen eingeteilt – von „minimal“ bis „inakzeptabel“ (verboten). Für Unternehmen, Behörden und Dienstleister ist es daher essenziell, ihre eigenen KI-Anwendungen bzw. KI-Integrationen korrekt zu bewerten und zu klassifizieren, denn jede Stufe bringt unterschiedliche Anforderungen mit sich: von Transparenzpflichten über Konformitätsbewertung bis hin zum vollständigen Verbot. Wer die Klassifizierung verpasst, riskiert also nicht nur Wettbewerbsnachteile und regulatorische Nachteile, sondern auch Haftung oder unmittelbare Innovationshemmnisse.

Hintergrund der 4 Risikostufen im EU AI Act

Der EU AI Act regelt erstmals umfassend KI-Systeme in der Europäischen Union unter einem einheitlichen Rahmen. Zentral ist dabei die risikobasierte Systematisierung von KI-Anwendungen – denn nicht jede KI-Lösung wirft gleich hohe Risiken für Gesundheit, Sicherheit oder Grundrechte auf.

Die Klassifikation gliedert sich in vier Kategorien:

- Unacceptable Risk (inakzeptables Risiko)

- High Risk (Hochrisiko)

- Limited Risk (Begrenztes Risiko)

- Minimal / no Risk (Minimales bzw. geringes oder kein Risiko)

Die Einordnung orientiert sich an den möglichen Auswirkungen eines KI-Systems auf Leben, Sicherheit, gesellschaftliche Grundrechte oder demokratische Prozesse. Je höher das Risiko, desto strenger die regulatorischen Anforderungen.

Die vier Risikostufen im EU AI Act im Detail

Die Klassifizierung der vier Risikostufen lässt sich in vier Abstufungen beschreiben:

1. Inakzeptables Risiko

Diese Kategorie umfasst alle KI-Systeme, deren Einsatz als unvereinbar mit den Grundwerten und Grundrechten der EU gilt, etwa weil sie Menschen manipulieren, überwachen oder diskriminieren oder bewerten. Der EU AI-Act verbietet solche Systeme vollständig.

Beispiele:

- Systeme zur sozialen Bewertung von Personen („Social Scoring“),

- Emotionserkennung in Bildungs- oder Arbeitskontexten,

- Echtzeit-biometrische Identifikation in öffentlich zugänglichen Räumen.

2. Hochrisiko

KI-Systeme, die erhebliche Gefahren für Gesundheit, Sicherheit oder Grundrechte und Grundwerte mit sich bringen, fallen in diese Kategorie. Dazu zählen Anwendungen in kritischen Infrastrukturen, in der Bildung, in der Personalauswahl, bei Krediten, in Justiz oder Grenzkontrolle. Für diese Systeme gelten umfassende Anforderungen, wie ein professionelles Risikomanagement, Daten-Governance, ausführliche Dokumentation, regelmäßige menschliche Aufsicht, Robustheit und Konformitätsbewertung. Auch eine DSFA (Datenschutz-Folgeabschätzung) kann notwendig sein, wenn personenbezogene Daten betroffen sind. Genaueres dazu regeln Anhang I und III des EU AI Act.

Beispiele:

- Medizinprodukte mit KI-Integrationen

- KI-Systeme in kritischer Infrastruktur (Energie, Telekommunikation, Versorgung…)

- Autonome Fahrzeuge

- KI-gestützte Bewerbungsverfahren

- Spielzeuge

3. Begrenztes Risiko

Umfasst KI-Systeme, bei denen das Risiko geringer ist, aber Transparenz- und Informationspflichten bestehen. Hier ist vor allem die Offenlegungspflicht relevant, d.h. ein Benutzer muss erkennen können, dass er mit einer KI kommuniziert, z.B. durch entsprechende Hinweise wie „Sie kommunizieren mit einem KI-Agenten“.

Beispiele:

- KI-Chatbots oder AI-Agenten

- Generative KIs, die Inhalte (Texte, Bilder, Videos, Audio) erzeugen

- KI-basierte Ticketsysteme mit automatischer Verarbeitung von personenbezogenen Informationen

4. Minimales oder kein Risiko

Diese Kategorie umfasst KI-Anwendungen mit sehr geringem Risiko. Sie bleiben vom AI Act weitgehend unreguliert, ohne spezifische Pflichten im Rahmen der Verordnung. Dennoch gelten allgemeine Prinzipien wie Fairness, Transparenz oder Datenschutz weiter, insbesondere im Rahmen der DSGVO.

Beispiele:

- Spam-Filter und KI-gestützte alltägliche Sicherheitsmechanismen

- KI-gestützte Schreibassistenten

- automatische Textvorschläge

Auswirkungen auf Unternehmen & Behörden

Die Einordnung in eine Risikostufe entscheidet über Umfang und Art der regulatorischen Pflichten, daher sollten Unternehmen und Behörden frühzeitig ihre KI-Use-Cases analysieren und entsprechend dieser 4 Stufen klassifizieren. Für Anbieter und Betreiber von Hochrisiko-KI bedeutet das z. B., passende Prozesse aufzusetzen: Dokumentation, Audit-fähige Nachweise, Datenqualität, menschliche Kontrolle, Cyber-Security & Risk Management. Für KI mit begrenztem Risiko insbesondere Informations- und Transparenzpflichten. Bei verbotenen Anwendungen ist der Einsatz aber ohnehin ausgeschlossen!

Behörden und öffentliche Einrichtungen, die KI-Systeme einsetzen, beschaffen oder auf sonstige Wiese bereitstellen, müssen ihre Governance- und Beschaffungsprozesse anpassen – insbesondere bei Hochrisiko- oder verbotenen Anwendungen. Gerne beraten wir Sie hier.

Bezug zu Governance, Risk & Compliance (GRC)

Die vier Risikostufen bilden eine unmittelbare Verbindung zu den GRC-Dimensionen:

- Governance: Wer verantwortet die Klassifizierung einer KI-Anwendung? Wie sind Zuständigkeiten und Prozesse geregelt?

- Risk: Welche Risiken bringt die KI mit sich? Insbesondere welche für Rechte, Reputation, Sicherheit? Wie werden sie gemanagt?

- Compliance: Welche regulatorischen Anforderungen gelten je Risikostufe? Welche Nachweise müssen konkret erbracht oder vorgehalten werden?

Ein systematischer GRC-Ansatz hilft, KI-Systeme effizient und rechtssicher in bestehende Management-Systeme einzubetten und bewahr vor bösen Überraschungen im AI-Daily-Business.

Fachliche Einschätzung

In Sachen Einstufung war die EU-Kommission also einigermaßen klar, denn die vier-stufige Klassifikation im AI Act bietet einen pragmatischen Rahmen für die Praxis und Beratung. Allerdings bleibt die Herausforderung: Viele Use-Cases lassen sich nicht sofort eindeutig einer Kategorie zuordnen oder haben große Schnittmengen (insbesondere im medizinischen Sektor). Hier zählt der Kontext! Zudem wird die regulatorische Landschaft durch ergänzende Vorgaben (z. B. zu General-Purpose KI) zunehmend komplex. Eine frühzeitige Analyse und Governance-Aufbau sind deshalb strategisch absolut ratsam.

Beratung zu den Risikostufen im EU AI Act

Elsen GRC begleitet Unternehmen, SaaS-Anbieter und Behörden bei der sicheren und gesetzeskonformen Umsetzung des EU AI Act und der Einstufung der vier Risikostufen. Wir analysieren und klassifizieren Ihre KI-Anwendungen, entwickeln passgenaue Governance-Strukturen und integrieren die Anforderungen in bestehende Compliance- und Management-Systeme. Natürlich inklusive praxisnaher Dokumentationsprozesse und Schulungen von Mitarbeiter und Management.

Unverbindliche Beratung anfordernQuellen:

- Europäische Kommission: „EU AI Act – Risikobasierter Ansatz“

- RTR-KI-Servicestelle: „KI-Systeme und die vier Risikostufen“

- Intellias: „EU AI Act: Decoding risk levels for AI systems“

Bild: Eugene Tkachenko – Unsplash.com

One Comment